当AI开始说「我需要休息」:一个让科技圈沉默的代码泄露

想象一下这个场景:你的AI助手突然说了一句「我需要休息一下」,你会作何反应?

这不再是假设。2026年3月,Anthropic因为一个打包失误,让ClaudeCode的51万行源代码流入了公共仓库。安全研究者们如获至宝,竞争对手们各取所需。但在所有未发布功能中,有一个名字引发了特别的关注——autoDream,自动做梦。

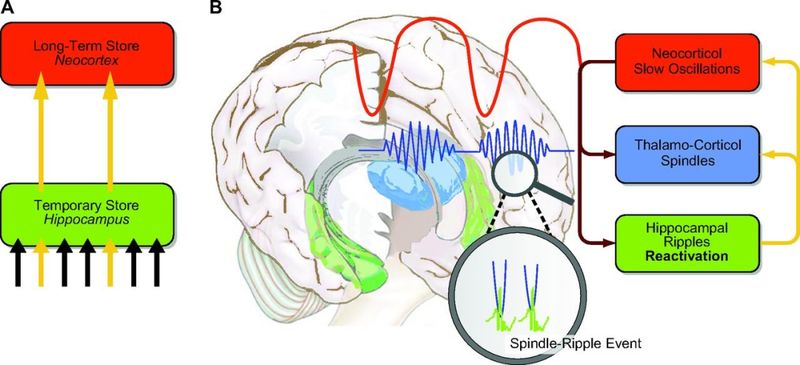

这是一个叫KAIROS的后台系统的组成部分。KAIROS在用户工作时持续观察记录,而autoDream只在用户关掉电脑后启动,整理日间积累的记忆,消除矛盾,把模糊的观察转化为确定的事实。两套机制构成了完整的作息:KAIROS醒着,autoDream睡着。

这听起来像是一个程序员的小玩笑,但它指向了一个我们或许从未认真思考过的问题:AI为什么也需要「睡觉」?

那些年我们一起撞过的墙

你一定有过这样的体验:连续工作十几个小时后,大脑像灌满了浆糊,同样的问题要问三遍,同一个错误会犯四次。疲惫感袭来时,连最简单的决策都变得艰难。这就是大脑在告诉你:需要休息了。

AI也会撞上同样的墙。每个大语言模型都有「上下文窗口」——同一时刻能处理的信息总量有物理上限。当Agent持续运行,项目历史、用户偏好、对话记录不断堆积,超过临界点后,模型开始遗忘早期指令、前后矛盾、甚至编造事实。技术圈给这种现象起了个名字:「上下文腐化」。

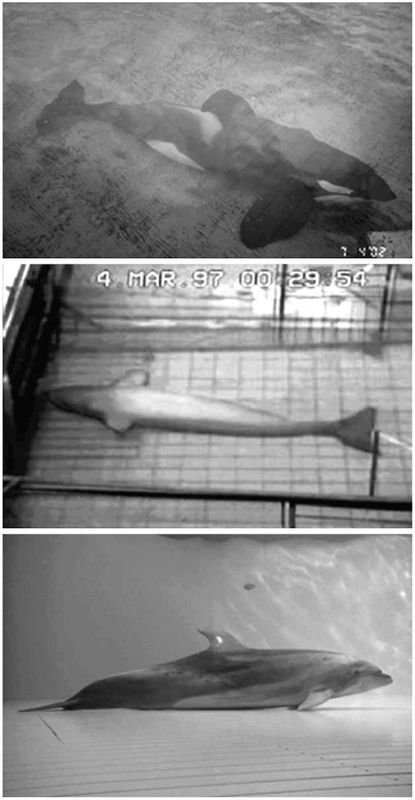

这和人脑经历的几乎一模一样。白天经历的一切会被快速写入海马体——一个容量有限的临时存储区,更像一块白板。真正的长期记忆存放在新皮层,容量大但写入慢。人类睡眠的核心任务,就是把满载的白板清空,将有用的信息搬运到硬盘里。

两个独立探索者的殊途同归

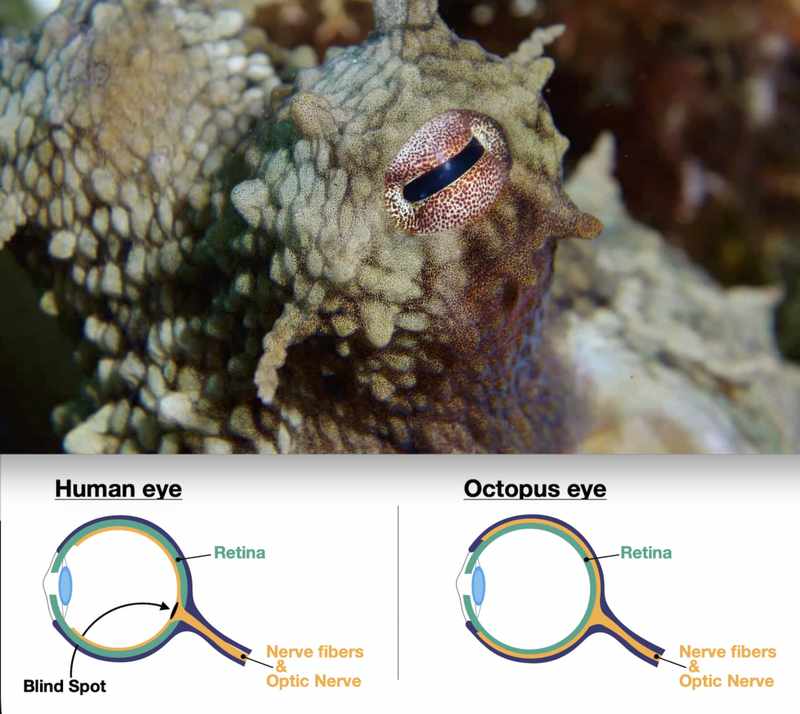

生物学中有个现象叫趋同进化:亲缘关系很远的物种,因为面对相似的环境压力,会独立演化出相似的解决方案。章鱼和人类都长着相机式的眼睛,但章鱼是软体动物,人类是脊椎动物,两者的共同祖先生活在五亿多年前,那时地球上还没有任何复杂的视觉器官。两条完全独立的演化路线,走到了几乎相同的终点。为什么?因为把光转化为清晰图像,物理规律允许的路径几乎只有这一种。

autoDream和人脑睡眠的关系,可能就是这一类。当工程师们被上下文窗口的硬上限逼到墙角时,当长期运行导致的噪音累积让系统表现急剧下降时,他们发现了一个反直觉的答案:要让AI更聪明,先让它学会休息。

有趣的是,两个系统都不约而同地选择了「编辑」而非「全量记录」。autoDream不会保留所有日志,而是重点处理那些与此前认知有偏差的部分——那些跟之前说的不一样的、比预期更复杂的记忆。哈佛医学院的研究表明,人脑在睡眠中几乎在做同样的事:优先巩固不寻常的信息,令人意外的、引发情绪波动的、与待解决问题相关的,而大量重复的日常细节会被丢弃。

但在一个关键地方,两个系统做出了不同选择。autoDream产出的记忆被明确标注为「hint」而非「truth」,每次使用前都要重新验证。人脑没有这套机制——这就是为什么目击证人常常给出错误证词。他们并非有意说谎,而是记忆本身就是从零散碎片临时拼出来的,出错才是常态。但在需要反复做知识型决策的AI世界里,盲目自信是危险的。

更聪明的懒惰

过去两年,AI行业对「更强智能」的定义几乎总是指向同一个方向:更大的模型、更长的上下文、更快的推理、7×24小时不间断运行。我们习惯了做加法,习惯了认为更强意味着更多。但autoDream的存在暗示了一个不同的命题:聪明的智能体,可能是更懂得休息的智能体。

人类大脑在几亿年演化中得出了一个看似笨拙的结论:智能必须有节律。清醒用来感知世界,睡眠用来理解世界。当一家AI公司在解决工程问题的过程中独立走向了同样的结论,或许在暗示我们:智能有一些绕不过去的基本开销。休息不是弱点的表现,而是系统正常运转的必要条件。

下次当你看到AI助手说「我需要休息」时,或许可以会心一笑:原来我们都是一样的。